GitHub Modelsとは?GitHubに統合されたAI開発ツール

GitHub Modelsは、AIを活用したアプリケーション開発を支援するために、GitHubのワークフローに統合された開発者向けツール群です。モデルの選定からプロンプトの調整、性能評価、そして本番環境へのリリースまで、AI開発のライフサイクル全体を一貫してサポートすることを目的としています。従来、別々のツールで行われがちだったプロンプトの実験、性能評価、バージョン管理といった作業を、GitHubリポジトリ内で完結させることで、開発プロセスの効率化と品質向上を実現できます。

本記事では、GitHub Modelsの基本的な機能から具体的な使い方、料金体系、そして企業での活用方法までを解説します。

GitHub Modelsとは?

AI開発を支援する統合開発環境

GitHub Modelsは、単なるAIモデルの呼び出しAPIではありません。AI開発プロセスの効率化と品質向上を図るための様々な機能が統合されています。GitHub Modelsを利用することで、プロンプトの実験や性能評価、バージョン管理といった一連の作業を同一環境で行えるため、チーム全体での開発効率と再現性が大幅に向上します。これにより、開発チームは一貫性のある方法で協力し、再現性の高いAI開発を実現できます。

こんな開発者・チームにおすすめ

GitHub Modelsは、以下のような課題を持つ開発者やチームにとって特に有用です。

- 個人開発者・初心者

- 複雑な環境構築なしに、すぐに様々なAIモデルを試したい方

- プロンプトエンジニアリングのスキルを手軽に学びたい方

- 開発チーム・中級者

- プロンプトをコードと同様にバージョン管理し、チームでレビューしたいチーム

- CI/CDパイプラインにAIの品質評価を組み込みたいチーム

- 企業管理者・上級者

- 組織内で利用するAIモデルを統制し、ガバナンスを効かせたい企業

- AI利用のコストを可視化し、最適化したい企業

AI活用の成熟度に合わせて段階的に調整できるため、チームの成長スピードに応じて無理なく導入範囲を広げられます。

GitHub Modelsの主要機能:何ができるのか?

GitHub Modelsが提供する中核的な機能を具体的に紹介します。プロンプト管理からモデル評価まで、開発の各フェーズで役立つツール群を解説します。これらのツールを組み合わせることで、アイデアの検証から実装までをスムーズに行うことができます。

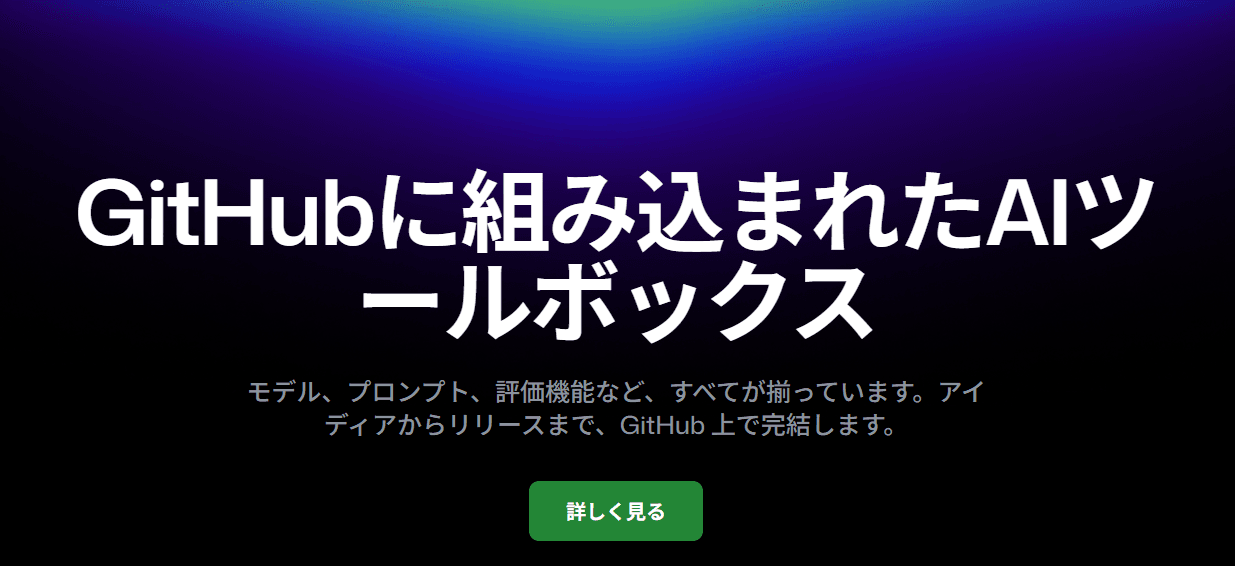

プロンプト開発とバージョン管理 (.prompt.yml)

プロンプト、使用モデル、パラメータ設定などを「.prompt.yml」というYAML形式のファイルで定義し、リポジトリで管理できます。

これにより、プロンプトの変更履歴をGitで追跡したり、Pull Requestを通じてチームでレビューしたりと、コードと同様の共同作業が可能になります。プロンプトの構成や評価条件がファイルとして明示されることで、再現性の高い検証が行いやすくなり、特定の担当者に依存しないナレッジ共有と運用に繋がります。

.prompt.ymlファイル

複数モデルの性能を比較する「Comparisons」

同じプロンプトと入力データに対し、複数のAIモデルやプロンプト構成の出力を並べて比較・評価できる機能です。

類似性や関連性といった客観的な指標を用いて、どのモデルやプロンプトが特定のユースケースに最適かをデータに基づいて判断できます。これにより、勘に頼らないモデル選定が可能になります。

Comparison

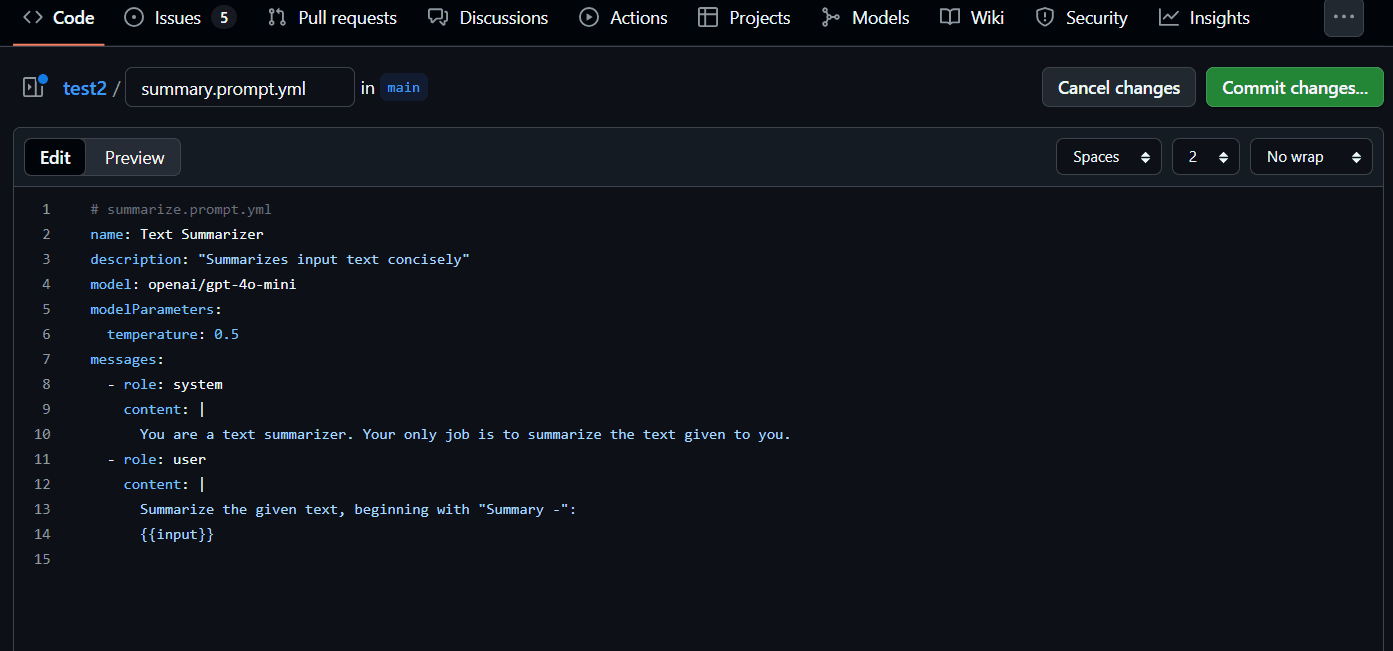

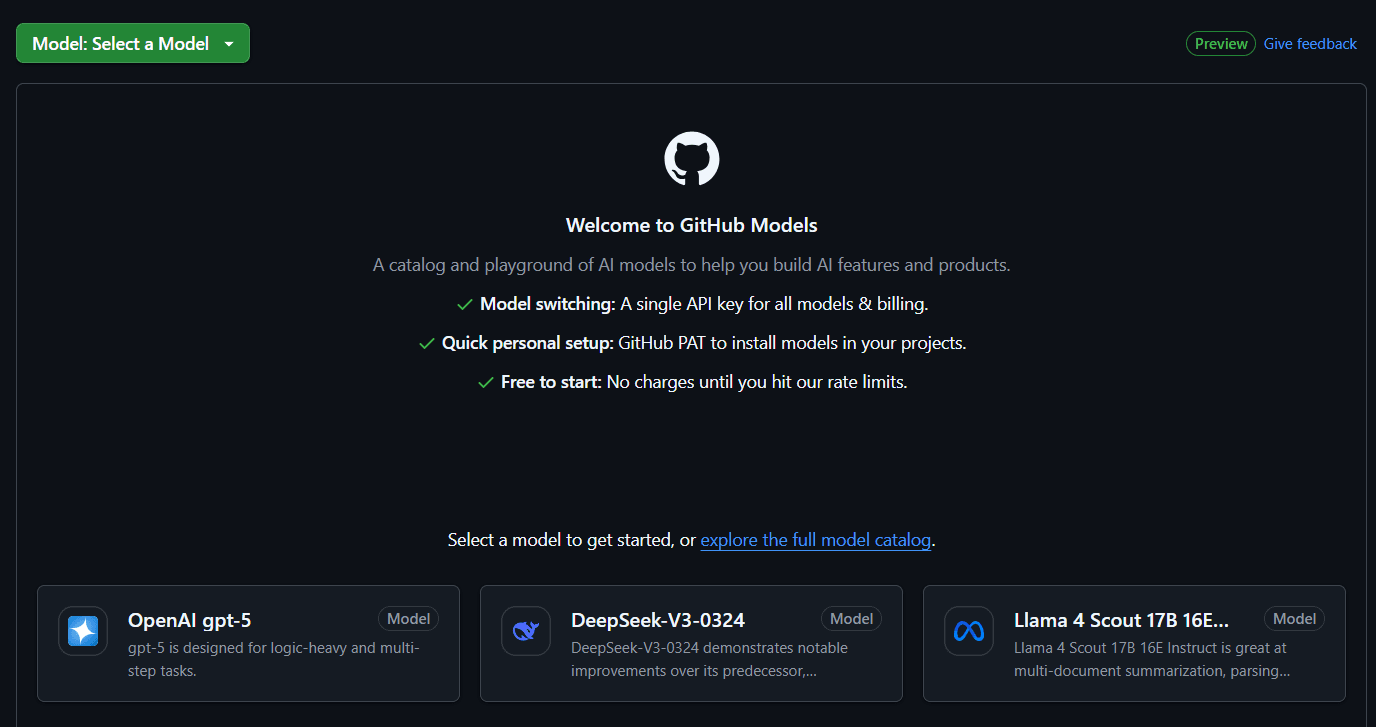

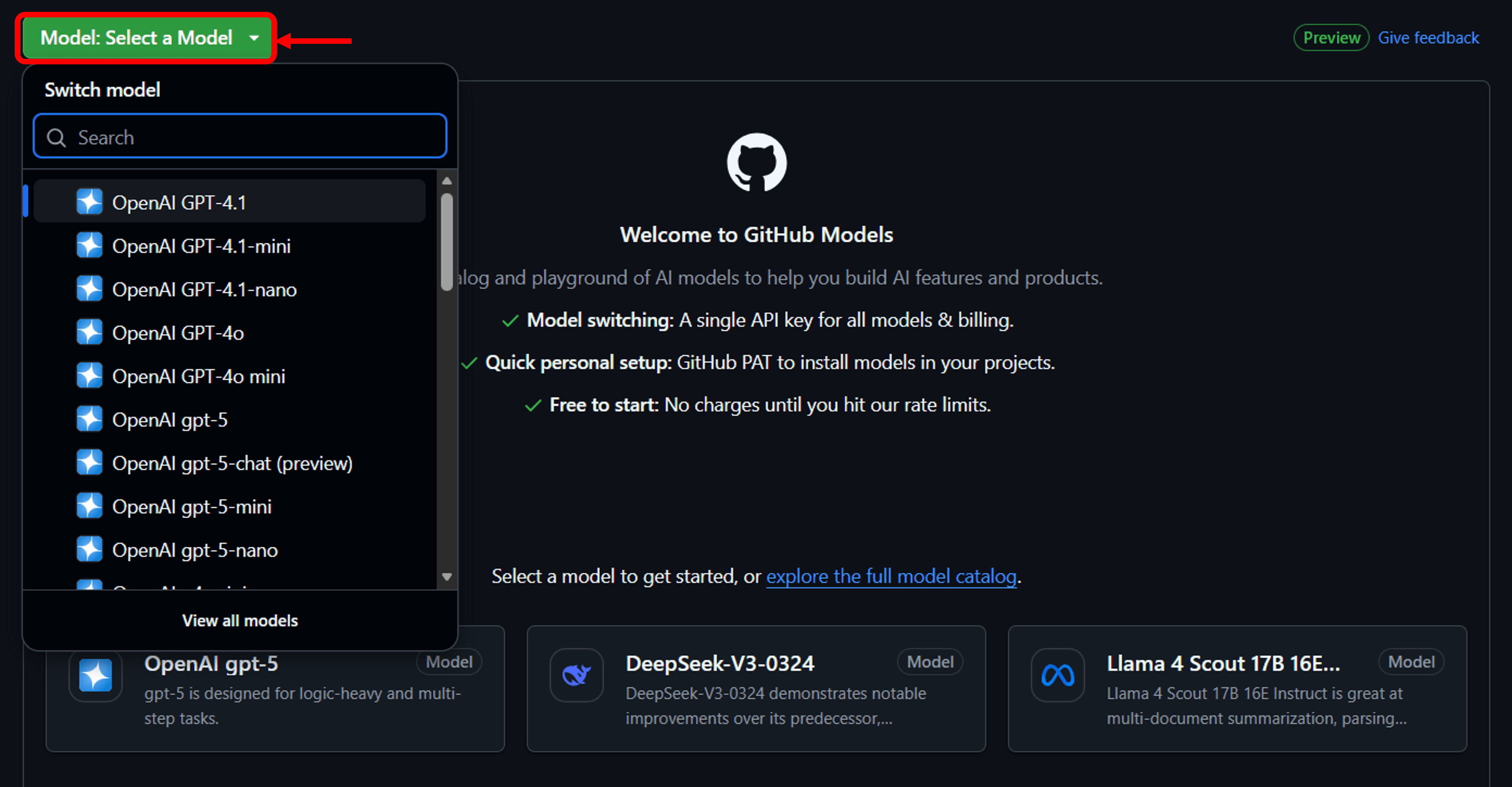

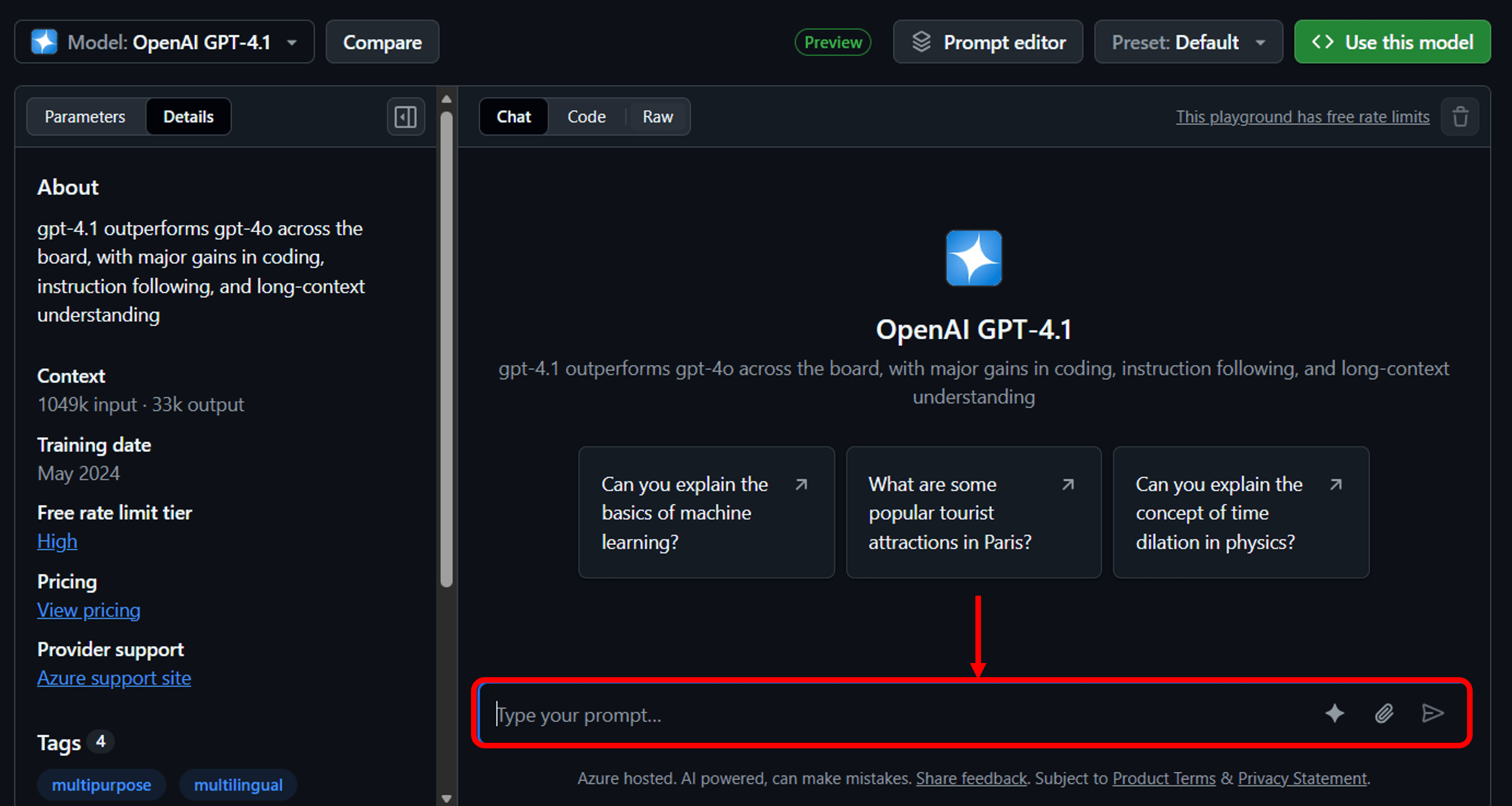

コード不要で試せる「Playground」

Webブラウザ上で、直感的にAIモデルを試せる実験環境です。

GitHub が提供する標準モデルを利用する場合、あらかじめコーディングや個別のAPIキー設定を行う必要はなく、モデルを選択してプロンプトを入力するだけで、ほぼリアルタイムに応答を確認できます。AIモデルの振る舞いや出力傾向を手早く把握したい初期の実験フェーズに特に適した環境であり、本格的な実装や評価ワークフローに進む前段階の検証に活用できます。

Playground

APIとGitHub Actionsによる自動化と連携

GitHub ModelsはREST APIを提供しており、外部アプリケーションやスクリプトからAIモデルをプログラムで呼び出すことが可能です。

さらに、GitHub Actionsと連携させることで、例えば「新しいissueが作成されたらAIで要約してコメントする」といったワークフローを自動化できます。CI/CDプロセスにAIを組み込むことで、開発プロセスそのものを効率化します。

GitHub Modelsの簡単な使い方

GitHub Modelsは、GitHub上で大規模言語モデル(LLM)を手軽に試せる機能です。特に初めて利用する場合は、Playgroundでモデルを動かしてみるのが最も簡単で、追加のセットアップやAPIキーも不要です。

Playgroundでモデルを試す

最も手軽なPlaygroundでの方法をご紹介します。

- GitHub MarketplaceのModelsページにアクセスします。

- ドロップダウンメニューから試したいモデル(例: openai/gpt-4o-mini)を選択します。

3. チャットでさまざまなプロンプトを入力し、異なるモデルの応答を比較できます

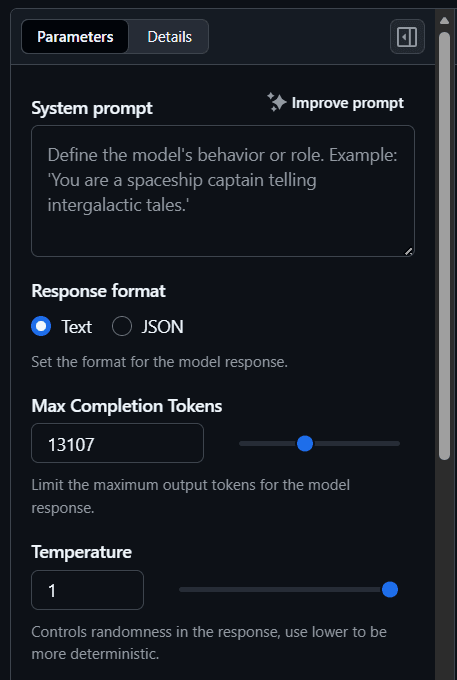

4.「 Parameters」では、温度や最大トークン数などの設定を調整して、応答の変化を確認できます。

GitHubアカウントにサインインしていれば、追加のセットアップやAPIキー不要で、コーディングなしにAIモデルの基本的な動作をすぐに体験できます。また、GitHub Modelsは、Playgroundだけでなく、curlを使ったAPI呼び出しや、GitHub Actionsと組み合わせたワークフロー自動化、.prompt.ymlファイルによるプロンプト管理、テストデータによる出力評価なども対応しています。実運用に組み込みたい場合や、再利用・品質管理を行いたい場合に活用できます。

※詳細な手順は、公式ドキュメントをご参照ください。

【組織向け】GitHub Models活用ガイド

個人での利用だけでなく、チームや企業全体でGitHub Modelsを統制・活用するための設定方法とそのポイントを紹介します。GitHub Modelsは、EnterpriseやOrganizationといった組織単位での利用を想定した管理機能も提供しており、ガバナンスとコスト管理を両立させながらAI開発を推進できます。

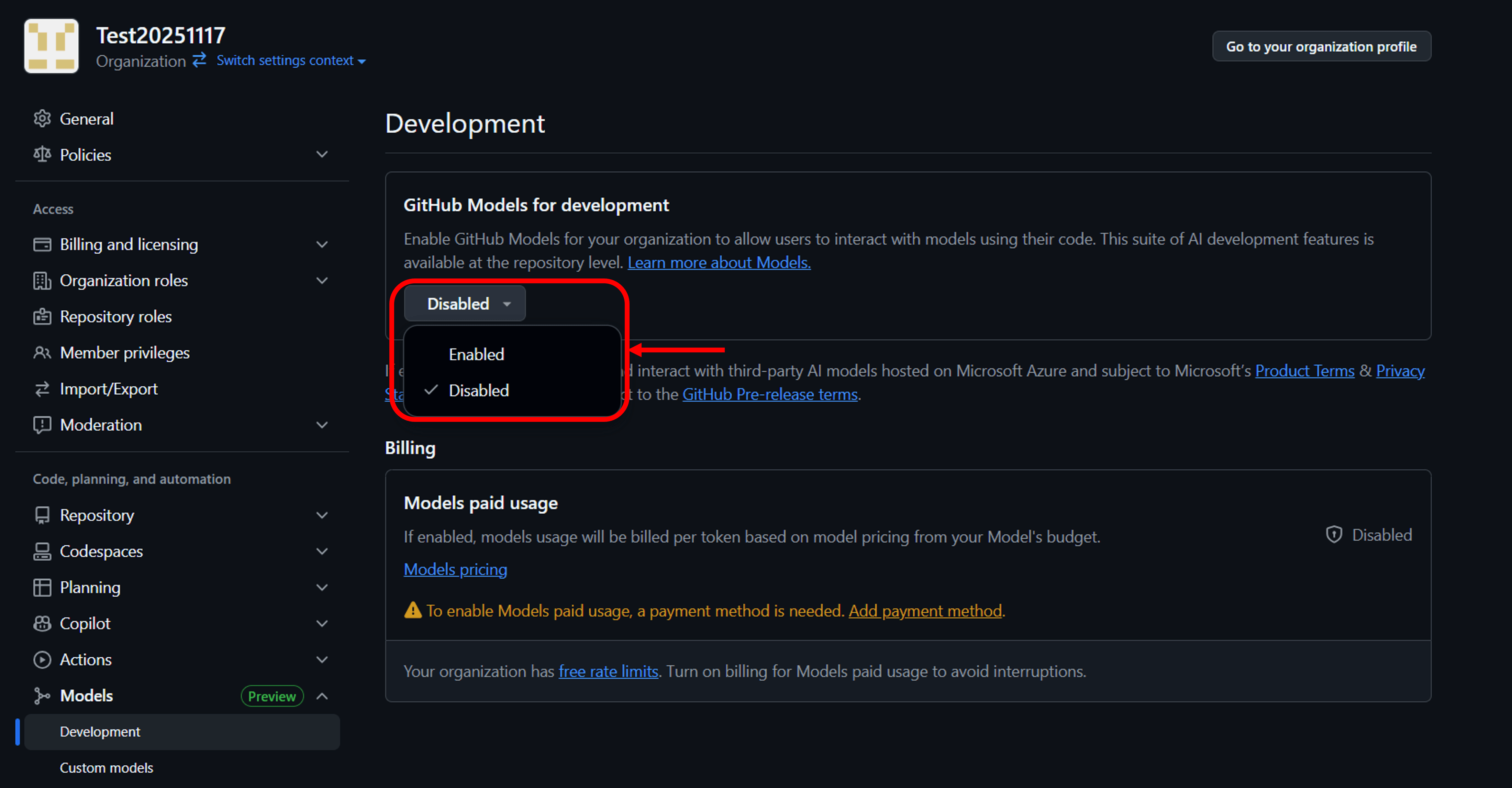

Organization/Enterpriseでの有効化手順

組織内でGitHub Modelsを利用するには、まずEnterpriseまたはOrganizationのオーナーが機能を有効にする必要があります。

- Enterprise/Organizationの「Settings」に移動します。

- サイドバーの「Models」セクションで、機能の利用を許可します。

3.その後、各リポジトリの設定で個別にModelsを有効化します。

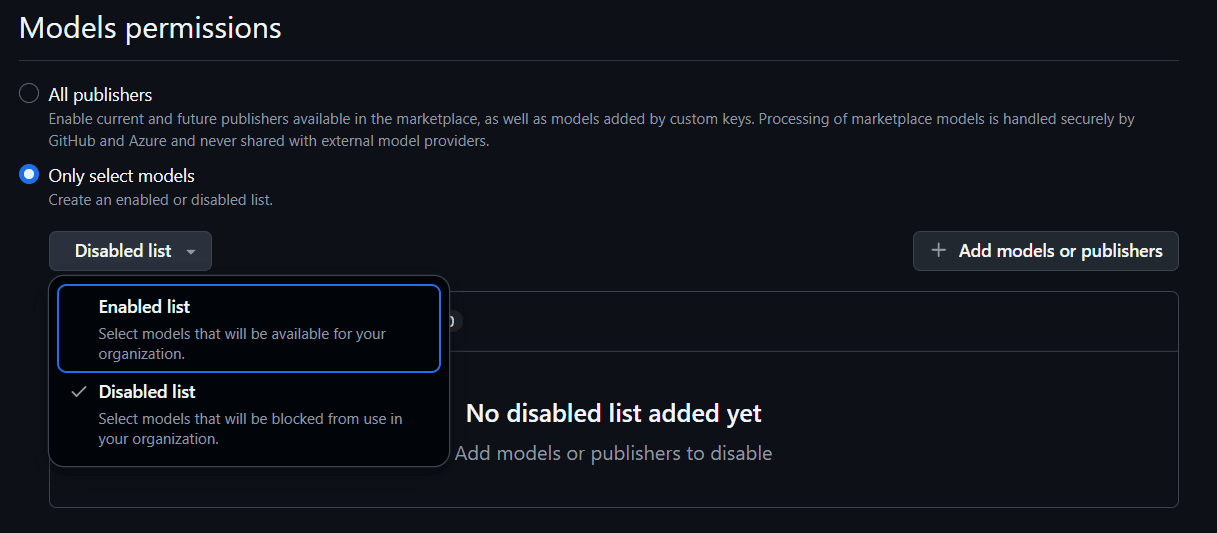

ガバナンス:利用可能なモデルの制限と管理

セキュリティやコンプライアンス、コストの観点から、組織内で利用できるAIモデルを制限したい場合があります。Organizationの設定画面では、以下のレベルで利用可能なモデルを制御できます。

- すべてのモデルを許可:GitHubが提供するカタログ上のモデルを原則すべて利用可能にする。

- 有効リスト(Enabled list)の作成:特定のモデルまたはパブリッシャーのみを許可し、それ以外を利用不可とする。

- 無効リスト(Disabled list)の作成:原則すべてのモデルを許可しつつ、特定のモデルのみ利用不可とする。

これにより、組織のポリシーや業界規制に準拠したモデルだけを開発者に提供しつつ、必要な柔軟性も確保できます。

利用可能なモデルの制限

コスト管理の鍵:「Bring Your Own Key (BYOK)」とは?

「Bring Your Own Key (BYOK)」は、組織がすでに契約しているAzureやOpenAIのAPIキーをGitHub Modelsに登録し、そのキーを使ってモデルを利用する仕組みです。BYOKを利用するメリットは以下の通りです。

- コストの一元管理: AIモデルの利用料金を、既存のAzureなどの請求にまとめることができます。

- 交渉済み料金の適用: プロバイダーと交渉済みの割引料金やクレジットをそのまま利用できます。

- 柔軟なモデル選択: GitHubが公式にサポートしていないカスタムモデルやファインチューニング済みモデルも利用できます。

ガバナンス・コンプライアンス要件を満たしつつ、自社の契約条件を最大限活かしたAI活用を行いたい企業にとって、BYOKは重要なオプションとなります。

※BYOKはパブリックプレビューで、2026年1月、現時点の対応プロバイダーはOpenAIとAzureAIに限定されています

大規模開発におけるベストプラクティス

組織全体でGitHub Modelsを効果的に活用するためには、以下のようなプラクティスが推奨されます。

- 共通プロンプトリポジトリの作成: 汎用的なプロンプト(例: コードレビュー、ドキュメント生成)を専用リポジトリで一元管理し、各チームが再利用できるようにします。

- Pull Requestでのレビュー: プロンプトの追加・変更は必ずPull Requestを通じて行い、チームメンバーによるレビューを徹底します。

- 定期的なコストと性能の評価: モデルの利用状況とコストを定期的に監視し、よりコスト効率の高いモデルへの見直しを検討します。

これらのベストプラクティスを継続的に運用することで、組織全体のAI活用レベルを標準化し、より信頼性の高いAI開発体制を構築できます。

GitHub Modelsの料金体系

GitHub Modelsのコストに関して、無料枠から有料プランの課金体系までをご紹介します。無料の利用枠を踏まえつつ、従量課金をどのように管理すれば予算内で運用できるかを整理していきます。

無料で利用できる範囲とレート制限

すべてのGitHubアカウントには、実験やプロトタイピングを目的とした無料の利用枠が提供されています。ただし、この無料枠にはモデルの種類やGitHub Copilotの契約プランによって異なるレート制限(単位時間あたりのリクエスト数上限)が設定されています。

レート制限のうち、今回はRPM/RPD(要求数)の例を示します。公式にはTokens per request / Concurrent requests / Embedding枠、さらに一部モデル別枠の上限もあります。

レート制限レベル | 項目 | Copilot Business | Copilot Enterprise |

低 | 1分あたりの要求数 | 15 | 20 |

1日あたりの要求数 | 300 | 450 | |

高 | 1分あたりの要求数 | 10 | 15 |

1日あたりの要求数 | 100 | 150 |

※上記は一例です。レート制限の詳細は予告なく変更される場合があります。最新情報は公式ドキュメント でご確認ください。

有料プランの課金単位「トークンユニット」とは?

無料枠を超えて利用する場合、GitHub Modelsの料金は「トークンユニット」という独自の単位に基づいて計算されます。

トークンとは、テキストをAIが処理できる最小単位に分割したもので、課金は単純なトークン数ではなく、以下の式で計算されるトークンユニットに対して行われます。

合計トークンユニット = (入力トークン数 × 入力乗数) + (出力トークン数 × 出力乗数)

価格は1トークンユニットあたり$0.00001で統一されており、モデルごとの価格差は後述の「乗数」によって調整されます。

【具体例】モデル別コスト計算方法と乗数一覧

モデルごとに、計算負荷や性能に応じて異なる「入力乗数」と「出力乗数」が設定されています。例えば、高性能なモデルほど乗数が高くなります。以下は、主要モデルの乗数と、100万トークンあたりの実質的な価格の例です。

モデル名 | 入力乗数 | 出力乗数 | 入力価格 (100万トークンあたり) | 出力価格 (100万トークンあたり) |

OpenAI GPT-4o | 0.25 | 1.0 | $2.50 | $10.00 |

OpenAI GPT-4o mini | 0.015 | 0.06 | $0.15 | $0.60 |

Grok 3 | 0.3 | 1.5 | $3.00 | $15.00 |

Llama-3.3-70B-Instruct | 0.071 | 0.071 | $0.71 | $0.71 |

※上記の価格と乗数は2026年1月執筆時点のものです。最新の情報は公式ドキュメントをご確認ください。

従量課金の支出を管理するための予算設定

意図しない高額請求を防ぐため、EnterpriseやOrganizationのアカウントでは、GitHub Modelsの利用額に対して月間の予算上限を設定できます。

予算作成時に「上限到達で利用停止(Stop usage when budget limit is reached)」を有効化すると、上限到達後の利用をブロックできます(無効の場合は通知のみ)。

まとめ:GitHub Modelsで次世代のAI開発を始めよう

本記事では、GitHubに統合されたAI開発ツールスイート「GitHub Models」について、その概要から機能、使い方、料金体系、企業での活用法までを網羅的に解説しました。GitHub Modelsは、AI開発における実験、評価、バージョン管理といったプロセスを、使い慣れたGitHubのワークフローにシームレスに統合します。これにより、開発者はAIをより身近なツールとして活用し、アプリケーションの価値を効率的に高めることができます。

パブリックプレビュー段階である今、まずは無料のPlaygroundからその可能性を体験してみてはいかがでしょうか。

東京エレクトロンデバイスは、GitHub Modelsの活用をはじめ、企業のGitHub Copilotの導入を支援しています。ご興味のある方は、お気軽にご相談ください。