Azure AI Foundryとは?

Azure AI Foundryとは、Microsoftが提供する企業向けの生成AIアプリ開発・運用のための統合プラットフォームです。

従来はエンジニアが中心となって構築していたChatGPTのようなAIアプリケーションや、社内ナレッジ検索ボット、音声議事録要約などの生成AIソリューションを、ノーコード(一部ローコードでも可能な操作あり)で直感的に開発・運用できる環境として設計されています。

また、このプラットフォームは継続的に進化しており、最近のアップデートでは、中核機能である「Azure AI Foundry Agent Service」の一般提供開始(GA)をはじめ、AIエージェント開発機能の強化や、より多様なAIモデルへの対応、オンデバイスAI開発環境の整備など、大幅な機能拡張が行われています。

Azure AI Foundryイメージ(参考:Azure AI Foundry)

つまり、「生成AIをビジネスで活用したい。でもエンジニアがいないし、どう作ればいいかも分からない……」という企業やチームのために、誰でも、簡単に、安全にAIアプリを作れるサービスがAzure AI Foundryです。

Azure AI Studioからの進化

Azureには既存のAIアプリの開発環境として、Azure AI Studioがありました。これは、Azure OpenAI Service を使ってプロンプト作成・モデル設定・評価・デプロイまでを行える、開発者向けのUIポータルです。

しかし、生成AIの普及と進化により、AIアプリを活用したいのはエンジニアだけではなくなりました。営業・人事・カスタマーサポート・マーケティングなど、さまざまな現場部門にて「自分たちの業務に合ったAIを自分たちで構築したい」「より自律的に動作するAIエージェントを活用したい」というニーズが現れるようになりました。

こうした背景と、「AIエージェントの時代」というビジョンを受けて、Azure AI Foundryは進化続けています。Azure AI Studioの機能を包含しつつ、非エンジニアでも使いやすく、企業全体で生成AIおよびAIエージェントを安心・安全に活用できる統合プラットフォームとして、その役割を拡大しています。

Azure AI Foundryの主要機能

ここでは、Azure AI Foundryが提供する具体的な機能について詳しくご紹介します。

特にAIエージェントの開発・運用、モデルの選択と最適化、オンデバイスAI、そしてファインチューニングの柔軟性といった領域で多くの機能強化が行われています。

ノーコード/ローコードでのAI開発

Azure AI Foundryでは、プログラミングの知識がなくても、GUIを使って生成AIを活用したアプリケーションやAIエージェントを開発できます。

たとえば、画面上でパーツをドラッグ&ドロップするだけで「質問を受ける → 社内データを検索 → 回答を生成 → ログを保存する」といった一連のチャットフローを視覚的に構成できます。

また、プロンプトの内容や出力形式、AIエージェントのオーケストレーションや監視機能もGUI上で柔軟に調整することが可能です。

AIエージェント関連機能( Azure AI Foundry Agent Service )

Azure AI FoundryではAIエージェントを構築するための様々なサービスが提供されています。その中核を担うのが、Azure AI Foundry Agent Service (一般提供開始)です。

複数の特化型AIエージェントを協調動作させるためのコアサービスであり、エージェント間通信(A2A)、Model Context Protocol (MCP) サポート、オブザーバビリティを提供します。

特徴的な機能は以下の通りです。

- プロンプトフローとの連携: エージェントの複雑なロジックやタスクシーケンスを視覚的に設計・管理。

- LangChain/LlamaIndex連携: 一般的なエージェント開発フレームワークとのシームレスな統合。

- Microsoft Entra Agent ID: 各AIエージェントに個別のIDを付与し、セキュアなアクセス管理とガバナンスを実現。

- Foundry Local : Windows AI Foundryプラットフォーム上で提供され、ローカル環境でのAIエージェント開発とテストをサポート。

- SDK:エンジニア向けにはPythonやJavaScriptのSDKも用意されており、自動化や外部システムとの連携も柔軟に実現できます。

これらの機能により、開発者はより高度で自律的なAIエージェントを効率的に構築し、ビジネスプロセスの自動化や高度化を実現できます。

【関連記事】

Azure AI Foundry Agent Serviceとは? AI エージェント開発を加速するクラウドサービスを解説

モデルカタログ:多様なAIモデルへのアクセス

Azure AI Foundryでは、さまざまなAIモデルを目的や用途に応じて柔軟に選択できます。利用可能なモデル数は1,900以上に増加し、xAI社のGrok-3やGrok-3-miniといった注目モデルが追加されるなど、エコシステムが大幅に拡充されています。

- 【Microsoft提供モデル】

Microsoftが提供する高信頼性・安全設計のAIモデル(Phiシリーズ)を利用できます。 - 【Azure OpenAI モデル】

GPTシリーズやoシリーズ、WhisperなどOpenAIが提供するAIモデルを、Azureのエンタープライズグレードのセキュリティとコンプライアンスのもとで利用できます。

動画生成AIモデルである「Sora」も、プレビューとして提供が開始されています。 - 【オープンソースモデル( Phi・Llama・Mistral など)】

Phiシリーズ、Mistral話題のオープンソースLLMにも対応しており、Azure AI Foundry上で直接デプロイ、ファインチューニング、推論が可能です。 - 【パートナーモデル(Hugging Face・xAI・Cohereなど)】

Hugging Face Hubの10,000以上のモデルや、Cohereのエンタープライズ向けモデル、そして新たにxAI社のGrokシリーズなどがモデルカタログ経由で利用可能です。ニーズに合わせて柔軟に選択できます。

これらのモデルは、「Model Router」機能を利用することで、プロンプトの内容や要件に応じて、これらの多様なモデルの中から最適なものを自動的に選択し、コストとパフォーマンスのバランスを取ることが可能になります。

Azure AI モデルカタログイメージ(参考:Azure AI モデルカタログ)

モデルのファインチューニング

Azure AI Foundryでは、自社が保有するデータセットを活用して、既存のAIモデルを特定の業務や業界に合わせて微調整(ファインチューニング)することが可能です。

これにより、例えばOpenAIのGPTのような強力な汎用モデルに対して、自社特有の製品知識、専門用語、コミュニケーションのトーンなどを追加学習させることができます。

また、最近発表された「Global Training」オプションを利用すると、より多くのAzureリージョンで、従来よりも低コストなトークン単価でファインチューニングを実行できます。

さらに、特定の最新モデル(GPT-4.1、GPT-4.1-miniなど)を対象とした「Developer Tier 」では、ファインチューニング済みモデルのホスティングが24時間無料となり、推論コストのみで評価やテストを行えるため、カスタムモデルの作成と検証が非常に手軽になりました。

※上記の機能は、プレビュー段階です。データレジデンシーや利用期間に関してはMicrosoftの公式情報を参考にしてください。

モデル評価と比較:ベンチマーク機能

企業が生成AIを活用する際に、「どのモデルを使えば一番いいのか?」という判断が必要になります。しかし、モデルごとに基本性能や得意分野が異なるため、選択に困ることも多いでしょう。

Azure AI Foundryのベンチマーク機能では、複数のモデルに同じ入力を与えて、以下のような観点で自動的に評価することができます。

- 出力品質(例:内容の正確さや自然さ)

- 応答時間(回答にかかる時間)

- コスト(そのモデルを使ったときの推定使用料金)

- 責任あるAIの観点(有害性、公平性など)

「Azure AI Foundry Observability」は、これらの評価結果やリアルタイムの運用メトリクスを統合的に監視・分析する機能を提供し、モデル選択や継続的な改善を支援します。

また、「Model Router」は、これらの評価軸を考慮して動的に最適なモデルを選択する機能を担います。

プロンプトフロー:生成AIアプリ開発の効率化ツール

Azure AI Foundryには、生成AIアプリの開発プロセスを効率化するための機能として「プロンプトフロー」が用意されています。

これは、ユーザーの入力に対してAIがどのように反応するかを、視覚的にステップごとに設計できるノーコードツールです。

たとえば、「ユーザーからの質問を受け取る → Azure AI Searchで社内文書を検索して該当情報を抽出 → 抽出情報を基にGPT-4oで回答を生成 → 生成された回答の精度(Content Safetyを活用)をチェック → 結果をユーザーに返す」といった一連の処理フローを、プログラミングを最小限に抑えて構築することができます。

また、プロンプトフローとAzure AI Foundry Agent Serviceとの連携が強化され、より複雑なAIエージェントのロジックを設計しやすくなりました。

RAG (検索拡張生成) の構築

RAGは、AIの応答を、外部の最新情報や社内ドキュメントなどの特定知識ソースに基づいてグラウンディング(事実に基づかせる)するための強力な手法です。

Azure AI Foundryでは、RAGを用いたシステム構成を、ノーコードまたはローコード(画面操作と設定)で効率的に実現できます。

AzureにおけるRAGの検索基盤: Agentic Retrieval in Azure AI Search

Azureでは以前から、Azure AI Search (旧 Azure Cognitive Search) を活用してRAGシステムを構築することが可能でした。このAzure AI Searchは、ベクトル検索のネイティブサポート、セマンティックランカーの機能改善、ハイブリッド検索の高度化など、継続的な機能強化により、より精度の高い情報検索を実現しています。

さらに、2025年5月には「Agentic Retrieval」がプレビューとして発表されました。これは、LLMによるクエリ分解など、RAGアプリケーションをさらに強化するための新しいアプローチです(プレビュー機能のため、今後のGAに向けて変更の可能性があります)。

Azure AI Foundryでは、これらの進化したAzure AI Searchの機能とのシームレスな連携やプロンプトフローを通じて、高性能なRAGシステムを効率的に構築できます。

セキュリティと責任あるAI (Responsible AI)

Microsoft Entra IDとの連携によってアクセス制御が可能なほか、 Azure AI Content Safetyによる有害な出力のフィルタリングや、プロンプトの内容やAIのやり取りを監査できる仕組み(Azure AI Foundry Observabilityなど)も整っています。

そのため、AI活用に対する企業内のセキュリティポリシーにも対応できます。

また、 Azure AI FoundryおよびCopilot Studioで作成されたAIエージェントに対して、Microsoft Entra Agent IDが自動的に割り当てられる機能が導入されました。

これにより、エージェントの識別、認証、認可が一元管理され、エージェントの「野放図な増殖」やセキュリティの死角を防ぎ、よりきめ細かいガバナンスとリスク管理が可能になります。

Azure AI Foundryの料金体系

ここでは、Azure AI Foundryの利用にかかるコストについて解説します。

課金体系の特徴

Azure AI Foundry自体に定額料金はなく、主に以下の利用サービスに応じた従量課金です。

- Azure OpenAI Service:

LLMの利用(トークン単位またはPTU課金)。 - モデルのファインチューニング:

トレーニングコスト: コンピューティングリソースとデータ量に応じて発生。新しい**「Global Training (プレビュー)」では低コストなトークン単価も提供されます。

ホスティングコスト: デプロイしたモデルの稼働に応じて発生。新しい「Developer Tier (プレビュー)」では特定モデルに対し24時間無料ホスティング**が提供されます。 - Azure AI Foundry Agent Service (GA):

エージェントがタスク実行のために呼び出すAzure OpenAI Serviceのモデル利用料、外部ツール利用料、および基盤となるコンピューティングリソースの消費に対してコストが発生します。 - Azure AI Search:

RAGなどでナレッジ検索に利用する場合、インデックスのサイズ、クエリ数、利用機能(ベクトル検索、セマンティックランカーなど)に応じて課金されます。 - 関連Azureサービス:

上記以外にも、プロンプトフローの実行に必要なコンピューティング、データ格納のためのストレージ等の利用料金が発生します。

その他のサービス料金詳細は、こちらをご覧ください。

※本記事に記載されている情報は、2025年6月時点の情報です。料金体系は変更される可能性があるため、最新の情報については公式ページで確認してください。

料金の見積もり

Azure AI Foundryの料金体系は以上のように利用したサービスに応じて課金されるため、Azure料金計算ツールで各サービスのコストを試算することが大切です。

Azureの料金計算ツールに利用予定のサービス(例:Azure OpenAI、Azure AI Search、Azure Storageなど)を入力することで、概算の月額コストを確認することができます。

【関連記事】

Azure料金計算ツールの使い方・見積もり作成のコツをわかりやすく解説

料金計算ツールイメージ(参考:料金計算ツール)

コスト管理のヒント

Azure AI Foundryでは、次のような工夫で無駄な支出を抑えながらAI活用を継続できます。

- 軽量なモデルから試す/Model Routerを活用する

まずは比較的コストの安いモデルで検証し、必要に応じて高性能モデルへ切り替えるのが効率的です。「Model Router (プレビュー)」は、タスクに応じてコスト効率の良いモデルを自動選択するのに役立ちます。 - ファインチューニング済みモデルのホスティングオプションを賢く選択する

ファインチューニングしたモデルをデプロイする際、利用頻度や目的に応じて、「Developer Tier (24時間無料ホスティング)」のようなオプションが利用可能か確認しましょう。常時稼働が不要な評価・テスト段階では、このようなオプションがコスト削減に大きく貢献します。

また、「Global Training 」でトレーニングコスト自体を抑えることも検討しましょう。 - 自動評価・監視は必要なときだけONにする

評価にもトークン課金があるため、最小限に抑えるのが得策です。 - ファイルやストレージは定期的に整理する

RAG用途で使ったファイルや生成されたログも不要になったら削除・アーカイブしてストレージコストを最適化しましょう。 - Azureの料金アラート機能を活用する

月次・週次で予算超過を防止しましょう。Microsoft Cost Managementの活用が望ましいです。 - Foundry Local を活用する

開発・テスト段階では、クラウドのコンピューティングリソースを消費しないFoundry Localを活用することで、コストを抑えられる可能性があります。

Microsoft Cost Managementイメージ(参考:Microsoft Cost Management)

Azure AI Foundry利用時に押さえておきたい3つの基本要素

Azure AI Foundryを使い始めるときに、まず登場するのが「Hub」「Project」「リソース」という言葉です。

このセクションでは、それぞれがどんな役割を持ち、どう関係しているのかをわかりやすく解説します。

Hub(ハブ)

Hubは、Foundryの最上位にあるリソースで、企業やチーム全体のAI開発をまとめる“本社”のような存在です。

- セキュリティ設定(VNetや認証)、計算リソースの共有、外部サービスとの接続を一元管理

- 複数のプロジェクトを束ねる

- Hub単位でストレージやGPUの割り当てが行われる

例:企業全体で1つのHubを作り、部門ごとにAI開発を進める

Project(プロジェクト)

Projectは、Hubの中に作る“開発部屋” のような単位です。用途別・チーム別に分けて、AIアプリやワークフローを構築することができます。

- Prompt FlowやRAG構成、ファインチューニングなどの作業を行う場所

- プロジェクトごとにデータやモデルのアクセス権を分けられる

- 開発中/本番用など、目的に応じて分離可能

例:「営業部のチャットボット用プロジェクト」「人事の社内FAQボット用プロジェクト」

リソース

リソースとは、各プロジェクトで使うAIモデルやデータ接続先などを指します。

Azureの各種サービス(Azure OpenAI Service、Azure AI Search、Storageなど)がここに該当します。

- AIモデル、Azure AI Search、Blob Storageなどを接続

- HubまたはProject単位で利用設定(Connection)可能

例:Project内でGPTもでrうを呼び出すためのAzure OpenAIリソース、PDF文書を検索するためのAI Searchインデックス

3つの関係性

Azure AI Foundryを使う上での「Hub」「Project」「リソース」の3つは必須要素であり、以下のようなトップダウン構成で作っていくのが基本となります。

- Hubを作成

組織レベルでのセキュリティやネットワーク設定をまとめます。GPUやストレージなどの基盤もここで管理します。 - Projectを作成(Hub内)

チームや用途ごとに分けて、開発環境をセットアップします。Prompt FlowやRAGなどもここで実装します。 - リソースを作成し接続する

Azure OpenAI、AI Search、Storageなどのリソースは、まずAzure Portalで作成し、その後FoundryのHubまたはProjectに接続します。

開発に必要な“道具”を揃えるステップです。

Azure AI Foundryの使い方

ここでは、実際にAzure AI Foundryを使い始めるための基本的なステップを紹介します。

前提条件:Azureアカウントとサブスクリプション

Azure AI Foundryを利用する前提条件として、以下が必要です。

- 有効な Azure サブスクリプション

- Foundry ハブへのアクセス権

- 「共同作成者」または「所有者」ロールであればハブの作成も可能です。

- 「Azure AI Developer」ロールの場合は、事前にハブが作成されている必要があります。

- サブスクリプションのクォータ制限を超えていないこと(モデル新規デプロイ時)

- ハブと必要なAzureリソース(OpenAI、Storageなど)が作成済であること

ステップ1:モデルのデプロイ(プロジェクト作成を含む)

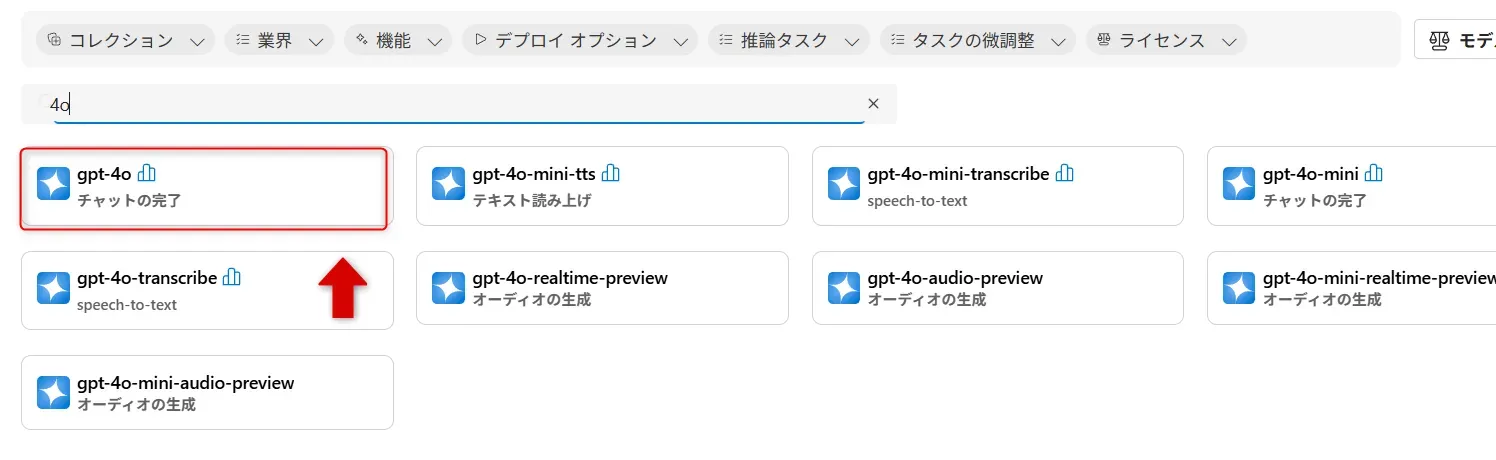

使いたいAIモデルを選び、プロジェクトにデプロイする準備をします。

- Azure AI Foundry Studioにサインインし「モデルを探索」をクリックします。

モデルを探索ボタン

- モデルカタログから適切なモデルを選択します。ここでは例として、GPT-4oをクリックします。

モデル選択画面

- 「デプロイ」ボタンをクリックします。

デプロイボタン

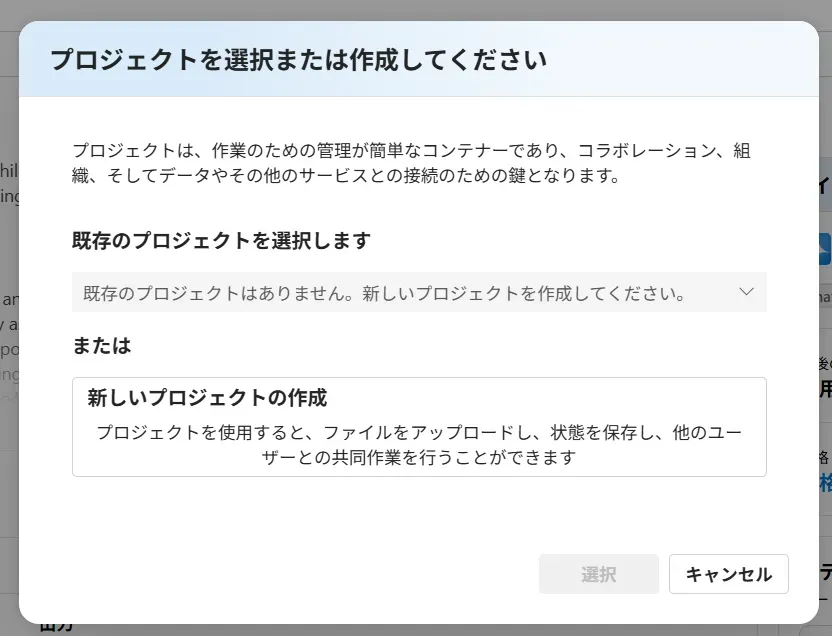

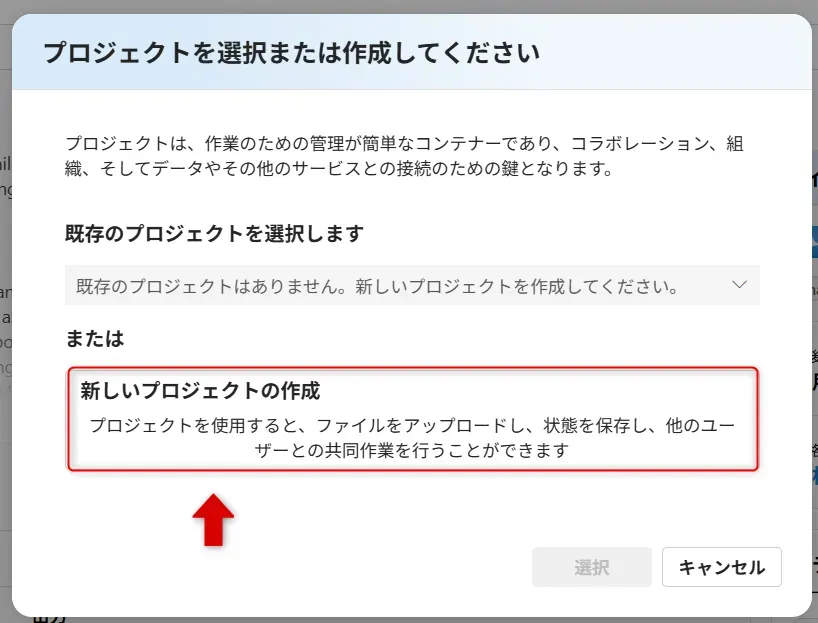

- プロジェクトを選択または作成をします。

プロジェクトの作成・選択画面

すでにプロジェクトがある場合:

既存のプロジェクトを選択してそのままデプロイします。

プロジェクトがない場合

「新しいプロジェクトの作成」をクリックします。

新しいプロジェクトの作成ボタン

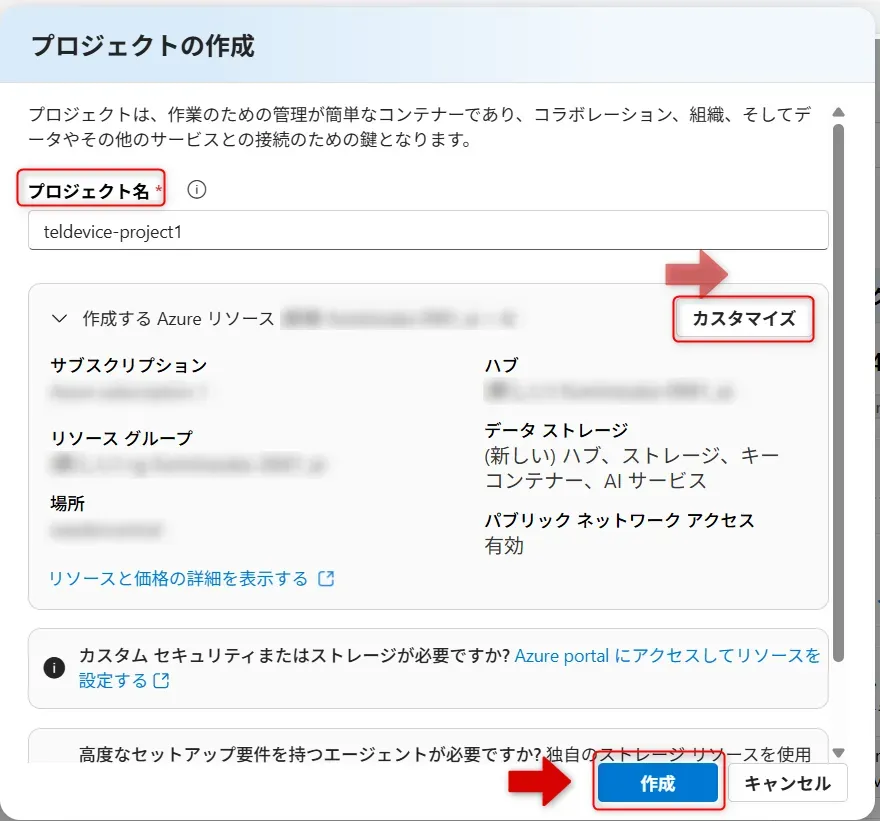

プロジェクト名を入力し、[作成] をクリックします。Azureリソースのカスタマイズを行う場合は、[カスタマイズ]から行うこともできます。

プロジェクトの作成画面

- [デプロイ名] やデプロイの種類を入力し、「デプロイ」をクリックします。

デプロイ画面

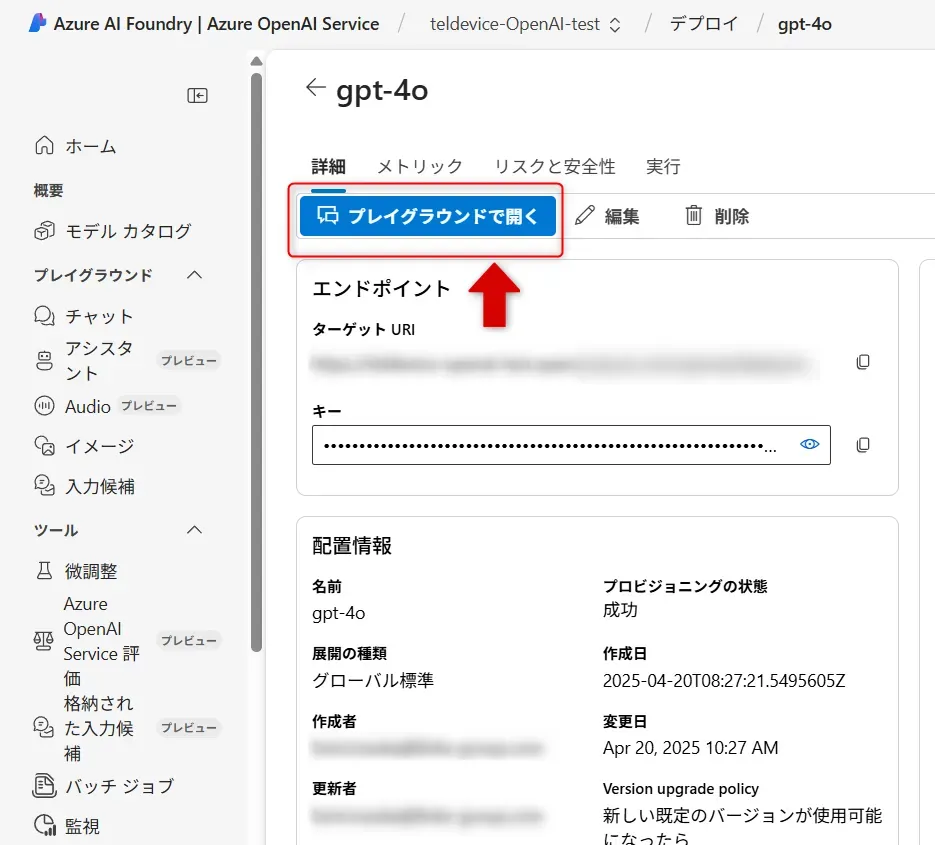

- デプロイが完了したら、「プレイグラウンドで開く」を選択します。すぐにチャットテストへ移動可能です。

プレイグラウンドで開くボタン

ステップ2:プレイグラウンドでチャットを試す

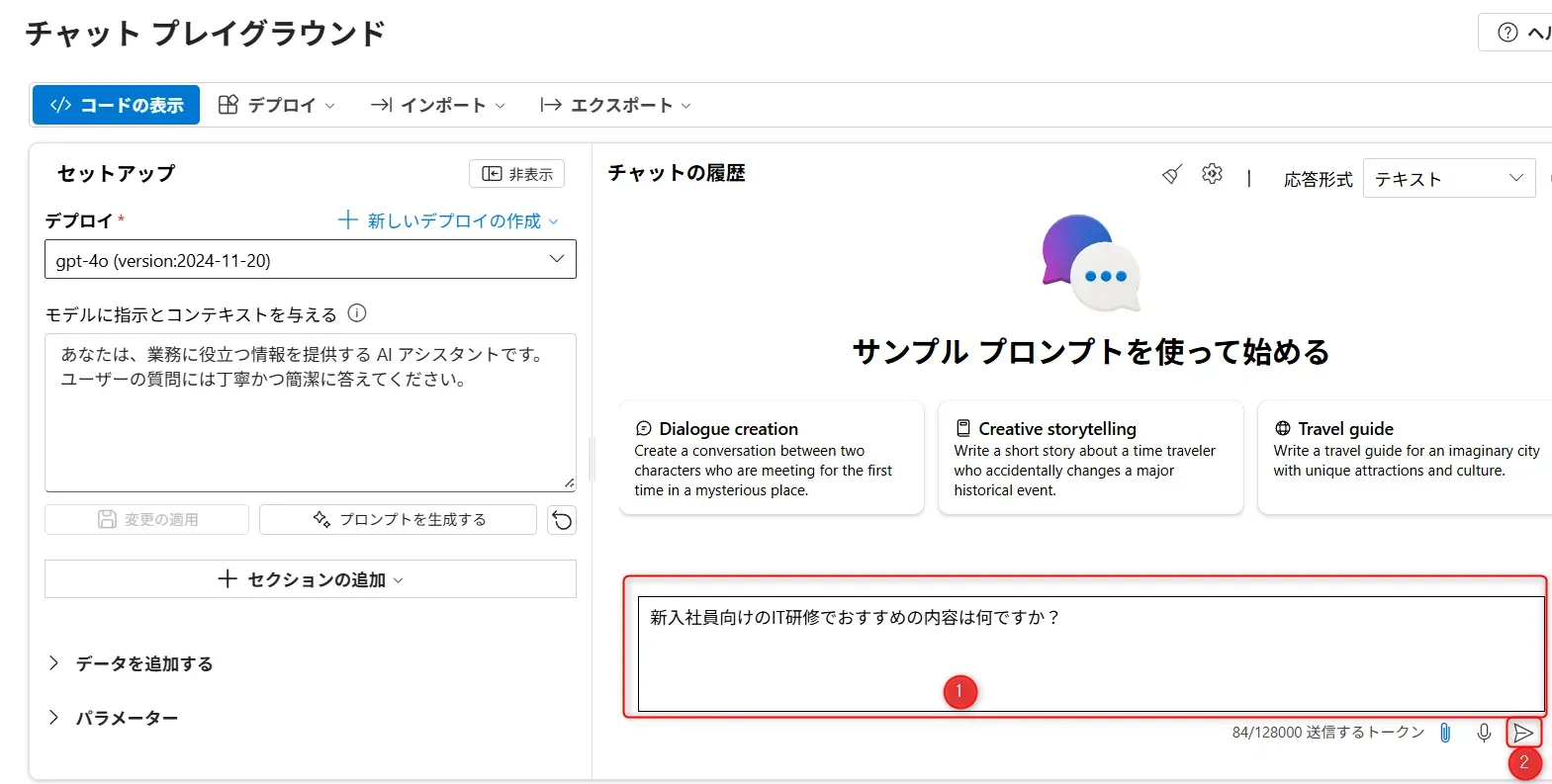

デプロイしたモデルが正しく応答するか、簡単にテストします。

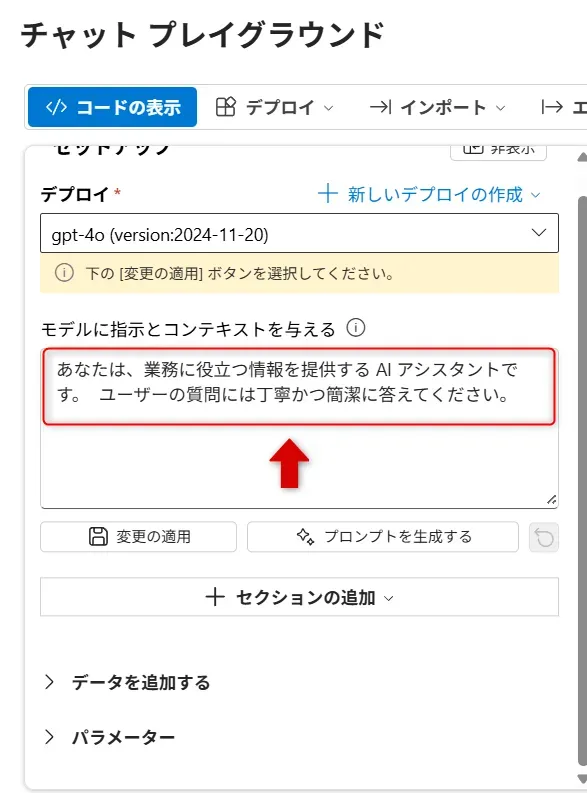

1. チャットの挙動をコントロールするための「システムメッセージ」を入力し、[変更の適用]をクリックします。

例: 「あなたは、業務に役立つ情報を提供する AI アシスタントです。 ユーザーの質問には丁寧かつ簡潔に答えてください。」

※用途に合わせて自由に編集可能です。

システムメッセージ例

2. チャット欄に質問を入力して、②送信します。

例: 「新入社員向けのIT研修でおすすめの内容は何ですか?」

チャット例

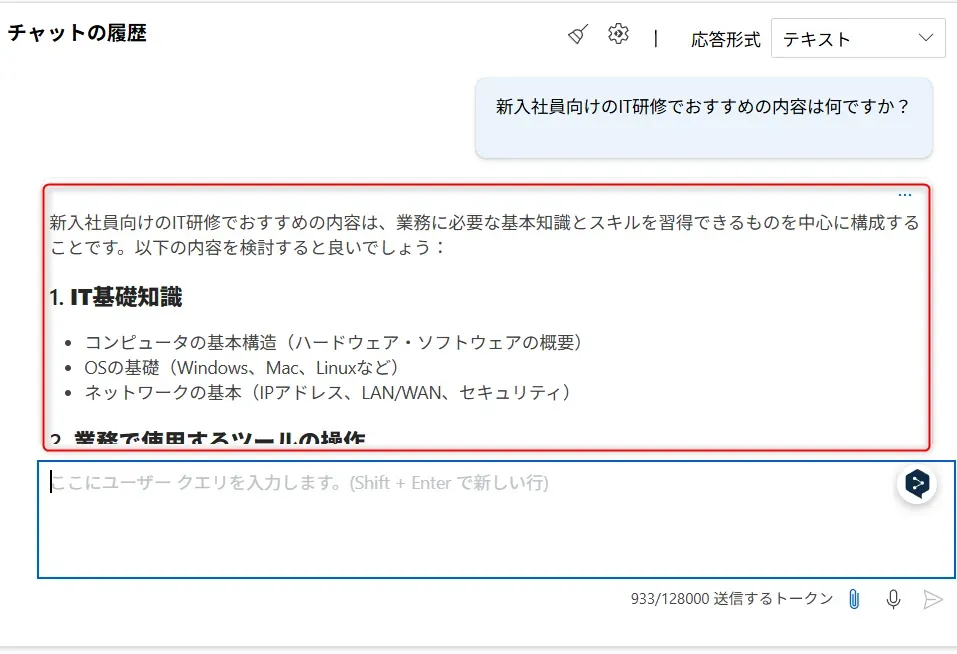

3. このように回答が作成されました。

回答例

Azure AI Foundryのユースケース

Azure AI FoundryはAIエージェント機能の強化やファインチューニングオプションの拡充により、自律的で複雑な業務自動化や、高度にカスタマイズされたAIソリューションのユースケースが広がっています。

このセクションでは、業界別・業務別のユースケースをご紹介します。

カスタムCopilot(AIアシスタント)およびAIエージェントの構築

Azure AI Foundryでは、独自のAIアシスタントや、より自律的にタスクを実行するAIエージェントをノーコード/ローコードで構築することができます。

- 営業支援AIエージェント

CRMと連携し、フォローアップ顧客リストに基づき、過去のやり取り(Azure AI Searchで検索・要約)を踏まえたパーソナライズされたメール案を Azure AI Foundry Agent Service活用して作成。Teamsでの承認後、自動送信までを一気通貫で実行。 - 社内ヘルプデスクAIエージェント

社員の問い合わせに対し、関連ドキュメントをAzure AI Searchで検索し回答。解決しない場合はITサポートチームの適切な担当者に作業依頼をエスカレーションし、チケットシステムに記録。

業界特化型AIソリューションの開発(例:金融、医療、製造)

業界固有の専門知識や規制に対応したAIアプリケーションやエージェントの構築が可能です。拡充されたモデルカタログや、ファインチューニングオプション、RAGを組み合わせることで、より専門性の高いソリューションが実現できます。

- 金融

AIエージェントによる市場トレンド分析と日次レポート自動生成、顧客データに基づくパーソナライズされた投資アドバイスボット、不正取引パターンの早期発見システム。 - 医療

AIエージェントによる電子カルテからの重要情報抽出と診療サマリー作成支援、膨大な医学論文からの類似症例リサーチと最新治療法の提示、患者からの問診とトリアージ支援。 - 製造

AIエージェントによる生産設備のセンサーデータ監視と異常検知・予知保全アラート、サプライチェーンの最適化シミュレーションと意思決定支援、Foundry Localを活用したエッジデバイスでのリアルタイム品質検査AI。

コンテンツ生成(ブログ記事、マーケティングコピーなど)

マーケティングや広報部門では、AIによる多様なコンテンツ生成支援が可能です。「Model Router (プレビュー)」を活用し、コンテンツの種類や目的に応じて最適なモデル(例: 創造性重視ならGPT-4o、特定スタイルならファインチューニング済みモデル)を使い分けることもできます。

- 新製品のターゲット顧客層に合わせた複数の広告コピーバリエーションの自動生成。

- パーソナライズされたニュースレターやSNS投稿文案の作成。

- SEOキーワードに基づいたブログ記事の構成案作成と本文執筆支援。

社内ナレッジ検索・要約システムの構築

社内に蓄積された膨大なドキュメント(PDF、Word、Teamsチャット履歴など)を、AIが横断的に検索・要約し、必要な情報を迅速に提供するナレッジシステムを構築できます。

- 社員が「最新の経費申請規定と申請手順は?」と質問すると、AIエージェントが関連規定文書とワークフロー情報を検索・統合し、具体的な手順と必要書類を提示。さらに、申請システムへのリンクも提供。

- 過去のプロジェクト報告書や技術文書から、特定の技術課題に関する解決策や知見を抽出・要約し、新規プロジェクトの参考にする。

マルチモーダルAIアプリケーション(テキスト+画像など)

Azure AI Foundryは、Azure OpenAI Serviceを通じてGPT-4oのような強力なマルチモーダルモデルへのアクセスを提供し、テキストだけでなく画像や音声も扱えるAIアプリケーションの構築が可能です。

- 建設現場の安全管理AI

現場作業員が装着したウェアラブルカメラの映像と音声から、AIエージェントが危険行動や安全装備の不備をリアルタイムに検知し、警告を発する。 - 顧客サポートの高度化

顧客が送信した製品の不具合を示す画像や動画をAIが分析し、問題箇所を特定。過去の類似事例と解決策をナレッジベースから検索し、サポート担当者に提示。 - 会議分析と議事録作成

会議の音声録音と共有された画面(スクリーンショットや録画)をAIエージェントが分析し、発言者ごとのテキスト化、主要な決定事項やアクションアイテムの抽出、そしてマルチモーダルな情報を含む議事録の自動生成を行う。

上記のユースケースはほんの一例であり、Azure AI Foundryの柔軟な機能と連携性を活用することで、さまざまな業界・業務の課題解決に貢献できます。

Azure AI Foundry利用時の注意点とベストプラクティス

Azure AI Foundryは非常に高機能なプラットフォームですが、効果的に活用するためには以下の注意や工夫が必要です。

モデル選択の考え方:タスク適合性、コスト、ライセンス

Azure AI Foundryでは多様なモデルが利用可能です。選択時には以下の点を考慮しましょう。

- タスクへの適合性:

解決したい課題に対し、モデルの特性(得意な処理、精度、応答速度)が合っているかを見極めます。 - コスト効率:

トークン単価や推論コストだけでなく、ファインチューニングの「Developer Tier」や「Global Training」のようなコスト削減オプションも活用しましょう。 - ライセンス:

商用利用の可否など、各モデルのライセンス条件を必ず確認します。 - Model Routerの活用:

最適なモデルを自動選択する機能ですが、ルーティングルールの設定や評価基準の定義は慎重に行いましょう。

データプライバシーとセキュリティの確保

社内データを扱う際は、特に以下の点に注意してセキュリティを確保しましょう。

- Microsoft Entra Agent ID:

AIエージェントに個別のIDを割り当て、アクセス管理と監査を強化します。 - アクセス権限の最小化:

データソースや連携ツールへのアクセス権は必要最小限に留めます。 - データのマスキング:

機密情報や個人情報は、利用前にマスキングや除去を行いましょう。

責任あるAIの原則の実践(公平性、透明性など)

Azure AI Foundryは、「Responsible AI(責任あるAI)」の考え方に基づいた機能を備えています。

たとえば、有害コンテンツの検出や、出力の監査ログの取得など、AIが暴走しないための仕組みがあらかじめ用意されています。

ユーザーとしても、以下の視点で取り組むことが大切です。

- Azure AI Content Safety

有害コンテンツの検出・フィルタリング機能を適切に活用します。 - バイアスの検証:

多様なデータでテストし、AIの出力に偏りがないか検証・緩和します。 - 透明性と説明可能性:

「Azure AI Foundry Observability」でAIの動作を監視し、判断根拠を可能な範囲でユーザーに提示できるようにします。 - 人間の監督:

特に重要な意思決定には、人間によるレビューや承認プロセスを組み込みます。

コスト管理と監視の重要性

Azure AI Foundryは従量課金制のため、利用が増えるとコストも増えます。

無駄なAPI呼び出しや、重たいモデルの多用を避けるために、以下の対策をすることがおすすめです。

- Azure Cost Management and Billing:

予算アラートを設定し、コストを定期的に監視します。 - Foundry Localの活用:

開発・テスト段階ではローカル実行を活用し、クラウドコストを抑制します。 - API呼び出しの最適化:

無駄な呼び出しを避け、効率的なロジックを設計しましょう。

まとめ

この記事では、Microsoftが提供する次世代のAI開発・運用統合プラットフォーム「Azure AI Foundry」について、基本的な仕組みから主な機能、料金体系、活用事例、導入時の注意点やベストプラクティスまでを包括的にご紹介しました。

最新のアップデートでは、プラットフォームの中核機能である「Azure AI Foundry Agent Service」の一般提供開始(GA)に加え、Model Router、Foundry Local(Windows AI Foundryプラットフォームの一部)、強化されたObservability、そしてファインチューニングのための「Global Training」や「Developer Tier」(24時間無料ホスティング)といった多くの新機能が発表され、その能力は飛躍的に向上しています。

Azure AI Foundryを使えば、従来はエンジニアの手を借りないと難しかった生成AIアプリケーションや自律型AIエージェントの開発・運用が、ノーコード/ローコードで直感的に行えるようになります。

ぜひAzure AI Foundryを活用して、ナレッジ活用の高度化、インテリジェントな社内アシスタントやAIエージェントの構築、AIによるコンテンツ生成の効率化、そしてデータ駆動型の意思決定支援など、さまざまな分野での業務革新・自動化を実現してみてください。

この記事が、皆さまのAI活用戦略の一助となれば幸いです。

東京エレクトロンデバイスは、Azure AI Foundryをはじめとした企業のAI導入をサポートしています。

無料相談も受け付けておりますので、お気軽にご相談ください。